Con i cambiamenti climatici che causano l'innalzamento del livello del mare e l'intensificarsi delle tempeste, le coste di tutto il mondo si trovano ad affrontare rischi di erosione senza precedenti. Tuttavia, prevedere con precisione i cambiamenti della linea costiera è una sfida, soprattutto per quanto riguarda le tendenze a lungo termine. Recentemente, lo studio collaborativo internazionale ShoreShop2.0 ha valutato le prestazioni di 34 modelli di previsione della linea costiera attraverso test in cieco, rivelando lo stato dell'arte attuale nella modellazione costiera.

La linea costiera è il confine dinamico dove la terra incontra il mare, in costante mutamento a causa di onde, maree, tempeste e innalzamento del livello del mare. Circa il 24% delle coste sabbiose di tutto il mondo si sta ritirando a una velocità superiore a 0,5 metri all'anno e in alcune aree, come la costa del Golfo degli Stati Uniti, il tasso di erosione annuale supera addirittura i 20 metri.

Prevedere i cambiamenti della linea costiera è intrinsecamente difficile e complesso, poiché richiede la considerazione dell'interazione di molteplici fattori, tra cui l'energia delle onde, il trasporto dei sedimenti e l'innalzamento del livello del mare. Le previsioni accurate su lunghi periodi di tempo sono ancora più complesse.

I moderni modelli di previsione della linea costiera possono essere suddivisi in tre categorie: una basata su simulazioni fisiche, come Delft3D e MIKE21, che si fondano sulla meccanica dei fluidi e sulle equazioni di trasporto dei sedimenti; una ibrida che combina principi fisici con metodi basati sui dati, come CoSMoS-COAST e LX-Shore; e una interamente basata su tecniche statistiche o di apprendimento automatico, come le reti LSTM e le architetture Transformer.

Nonostante l'ampia varietà di modelli, la mancanza di criteri di valutazione unificati ha reso difficile il confronto delle prestazioni. Quale modello offre le previsioni più accurate? La competizione di test alla cieca ShoreShop2.0 offre un'opportunità ideale per confronti interdisciplinari.

La competizione internazionale di test alla cieca ShoreShop2.0 è una forma di collaborazione scientifica estremamente rigorosa. I team partecipanti vengono informati solo del sito di prova, che è un nome in codice per una baia o una spiaggia. Informazioni chiave come la sua posizione e il suo nome reale vengono tenute nascoste per evitare che conoscenze pregresse influenzino la calibrazione del modello. Inoltre, i dati vengono mantenuti riservati in sezioni, con i dati relativi al periodo 2019-2023 (a breve termine) e al periodo 1951-1998 (a medio termine) intenzionalmente non utilizzati. I modelli prevedono quindi le variazioni della linea di costa a breve e medio termine, verificandone infine l'accuratezza utilizzando i dati riservati. Questa impostazione consente confronti interdisciplinari di modelli costieri in condizioni completamente sconosciute.

Trentaquattro gruppi di ricerca provenienti da 15 paesi hanno presentato modelli, di cui 12 basati sui dati e 22 ibridi. Questi gruppi provenivano da istituzioni negli Stati Uniti, in Australia, in Giappone, in Francia e in altri paesi. Tuttavia, tra i modelli presentati mancavano modelli commerciali come GENESIS e i modelli basati sulla fisica Delft3D e MIKE21.

Un confronto ha rivelato che i modelli con le migliori prestazioni per le previsioni a breve termine, a cinque anni, erano CoSMoS-COAST-CONV_SV (modello ibrido), GAT-LSTM_YM (modello basato sui dati) e iTransformer-KC (modello basato sui dati). Questi modelli hanno raggiunto errori quadratici medi di circa 10 metri, paragonabili all'errore intrinseco di 8,9 metri nei dati di linea costiera telerilevati da satellite. Ciò indica che, per alcune spiagge, le capacità predittive dei modelli si stanno avvicinando ai limiti della tecnologia di osservazione. Naturalmente, altri modelli sono stati in grado di cogliere meglio i cambiamenti della linea costiera.

Un risultato sorprendente è stato che il modello ibrido ha ottenuto prestazioni paragonabili al modello basato sui dati. CoSMoS-COAST-CONV_SV (modello ibrido) combina processi fisici e operazioni convoluzionali, mentre GAT-LSTM_YM (modello basato sui dati) utilizza una rete di attenzione su grafi per catturare le correlazioni spaziali. Entrambi i modelli hanno ottenuto buoni risultati.

Per quanto riguarda le previsioni a medio termine, la serie LX-Shore (modelli ibridi) fornisce le previsioni più vicine ai dati misurati. Accoppiando i processi di trasporto sedimentario lungo la costa e lateralmente, questi modelli mantengono la stabilità a lungo termine, mostrando al contempo le risposte più coerenti con i dati misurati in caso di eventi tempestosi estremi. Le previsioni di questi modelli indicano che una singola tempesta di forte intensità può causare un arretramento transitorio della linea di costa fino a 15-20 metri, con un recupero completo che potrebbe richiedere da due a tre anni. La serie CoSMoS-COAST offre un'eccellente stabilità, mentre altri modelli potrebbero soffrire di deriva a lungo termine e di una risposta eccessiva.

I risultati del modello indicano chequalità dei datiQuesto rappresenta un fattore limitante fondamentale per le prestazioni del modello. Sebbene i dati di telerilevamento satellitare coprano un'ampia area, la loro risoluzione temporale è bassa, in genere settimanale o mensile, il che rende difficile cogliere il rapido recupero post-tempesta. Inoltre, il limite istantaneo dell'acqua è influenzato dal run-up delle onde e dalle maree, il che comporta errori transitori che possono influenzare le previsioni del modello.

Lo studio ha rilevato che la levigatura dei dati spazio-temporali, come l'utilizzo di robuste tecniche di filtraggio bidimensionale, può migliorare significativamente le prestazioni del modello. Successivamente, i modelli di test non ciechi presentati hanno ridotto l'errore medio del 15% grazie a una preelaborazione dei dati ottimizzata.

Il metodo di livellamento 2D robusto è un metodo avanzato di elaborazione del segnale specificamente progettato per gestire il rumore nei dati satellitari delle coste. In sostanza, si tratta di un algoritmo di filtraggio iterativo basato sui minimi quadrati ponderati, ed è altamente robusto rispetto a valori anomali come il rumore transitorio delle onde nelle immagini satellitari.

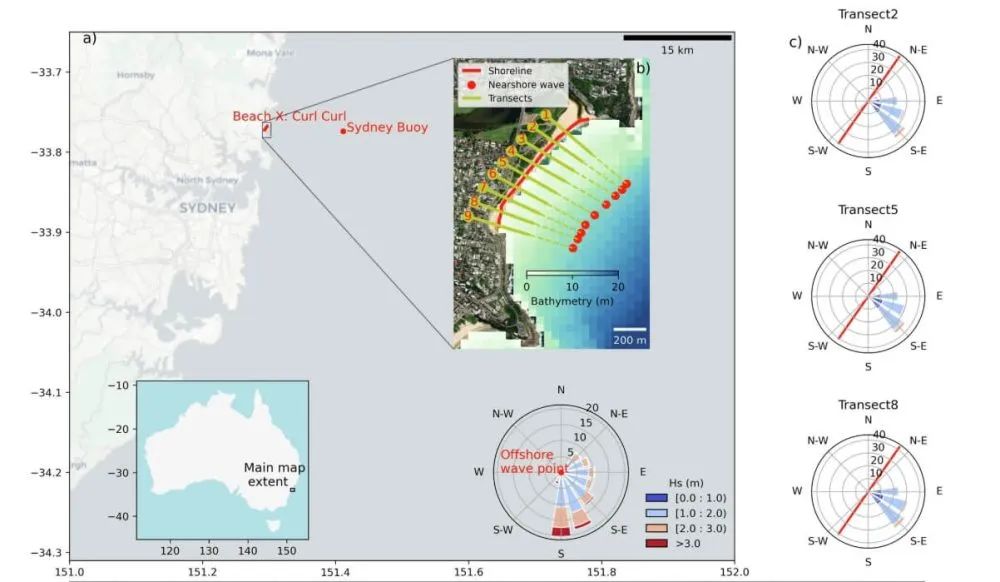

Un altro fattore cruciale per le previsioni dei modelli è l'accuratezza dei dati sulle onde in prossimità della costa. Attualmente, i dati sulle onde presentano diversi errori, tra cui errori nella conversione in ambiente costiero dei dati di rianalisi globale delle onde, distorsioni dovute all'estrazione dei parametri delle onde all'isobata dei 10 metri anziché nella zona di frangimento e la sottostima dell'impatto degli eventi estremi utilizzando le condizioni medie giornaliere delle onde. Tutti questi errori possono influenzare le previsioni dei modelli.

Per le previsioni a lungo termine, la maggior parte dei modelli si basa sulla classica legge di Brown per stimare l'impatto dell'innalzamento del livello del mare. Tuttavia, questa legge presuppone un apporto di sedimenti infinito ed equilibrato e ignora gli effetti del trasporto di sedimenti verso il largo o delle attività umane, come il ripascimento delle spiagge. Ciò può portare a significative distorsioni nei modelli.

Basandosi sulla teoria del profilo di equilibrio, la legge di Brown fornisce una relazione lineare tra l'innalzamento del livello del mare e l'arretramento della linea di costa. Questa teoria postula che un profilo costiero mantenga una forma di equilibrio. Con l'innalzamento del livello del mare, l'aumento dello spazio disponibile costringe questo profilo di equilibrio a spostarsi verso l'entroterra per mantenere la sua forma rispetto al nuovo livello del mare. Di conseguenza, la teoria postula che, man mano che il profilo costiero si sposta verso l'entroterra, lo strato superiore della spiaggia viene eroso e il materiale eroso si deposita al largo, causando l'innalzamento del fondale marino vicino alla costa e mantenendo così una profondità dell'acqua costante. La legge di Brown prevede che l'arretramento costiero possa essere da 10 a 50 volte maggiore dell'innalzamento del livello del mare, a seconda della pendenza della spiaggia.

Questo studio fornisce una base per la selezione di strumenti appropriati in base a esigenze specifiche. Inoltre, la preelaborazione dei dati è fondamentale; una corretta elaborazione dei dati può talvolta avere un impatto maggiore del modello stesso. Sfruttando l'esperienza acquisita con ShoreShop 2.0, è possibile apportare miglioramenti ai dati satellitari e ondosi per aumentare la precisione delle previsioni. Inoltre, gli effetti incontrollabili delle spiagge alterate artificialmente nelle previsioni a lungo termine possono influenzare significativamente i risultati. Infine, la scarsa partecipazione di modelli commerciali come GENESIS, Delft3D e MIKE21 rappresenta un problema rilevante.

Guardiani della Frontiera Blu: la missione undicennale di Frankstar per proteggere i nostri oceani e il clima.

Da oltre un decennio, Frankstar è all'avanguardia nella tutela dell'ambiente marino, sfruttando tecnologie di punta e rigore scientifico per fornire dati oceanici e idrologici senza precedenti. La nostra missione va oltre la semplice raccolta di dati: siamo artefici di un futuro sostenibile, consentendo a istituzioni, università e governi di tutto il mondo di prendere decisioni informate per la salute del nostro pianeta.

Data di pubblicazione: 11 agosto 2025